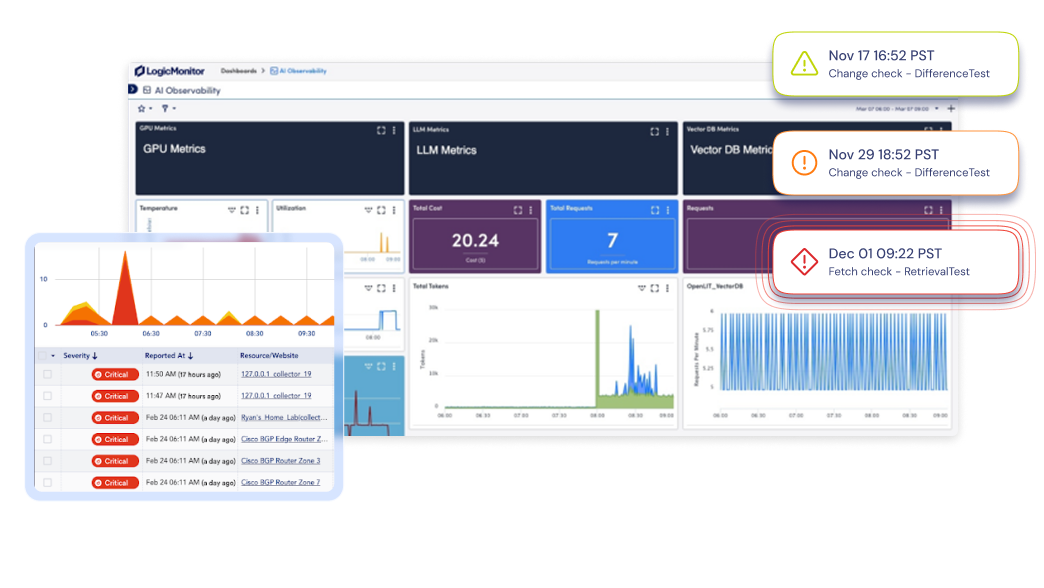

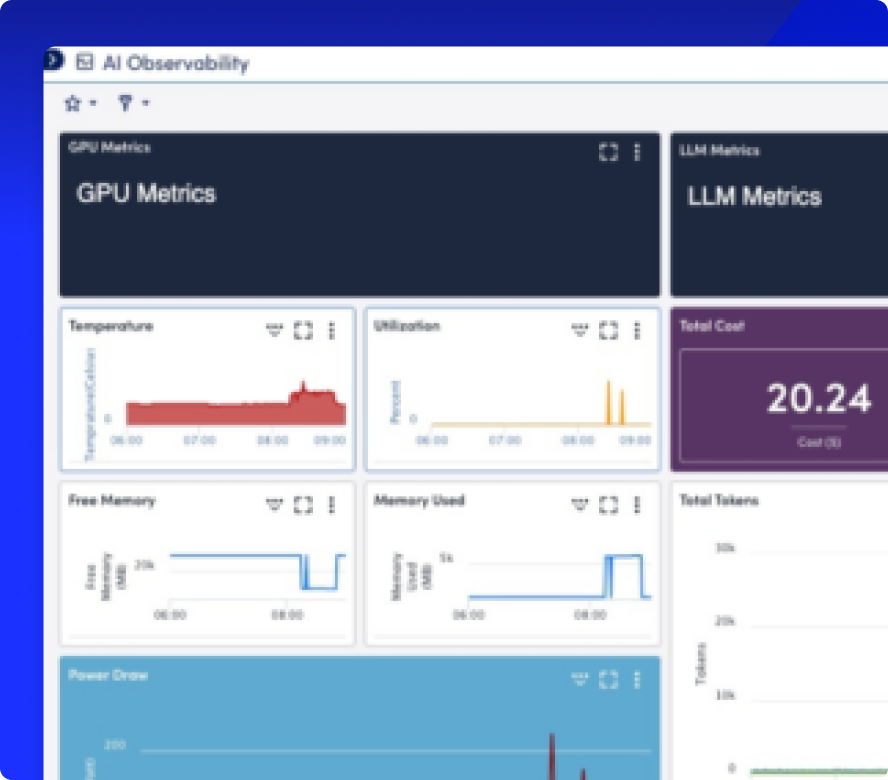

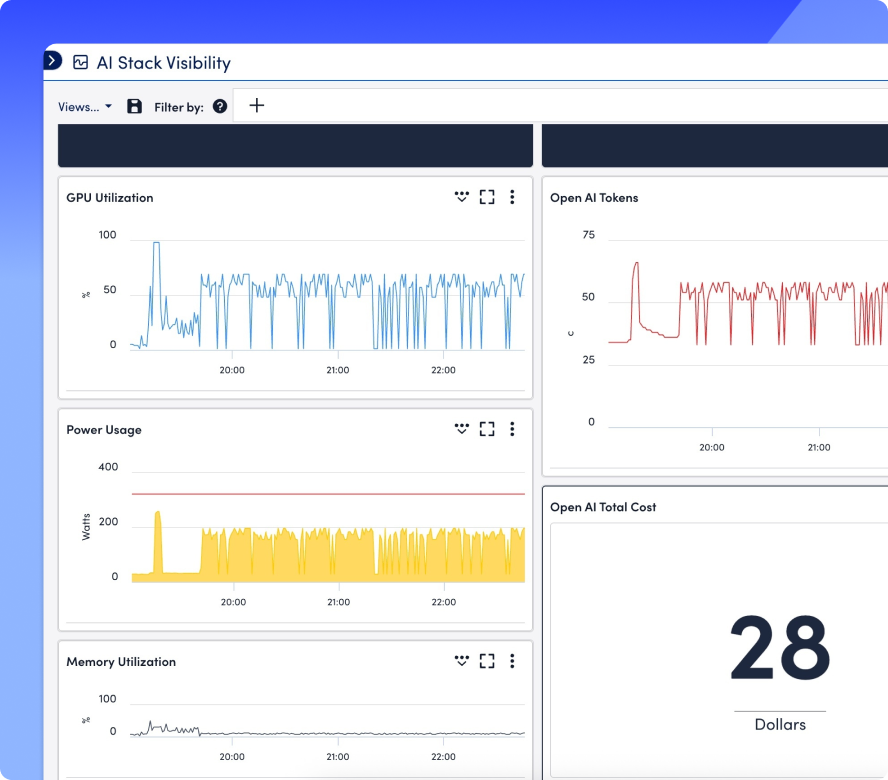

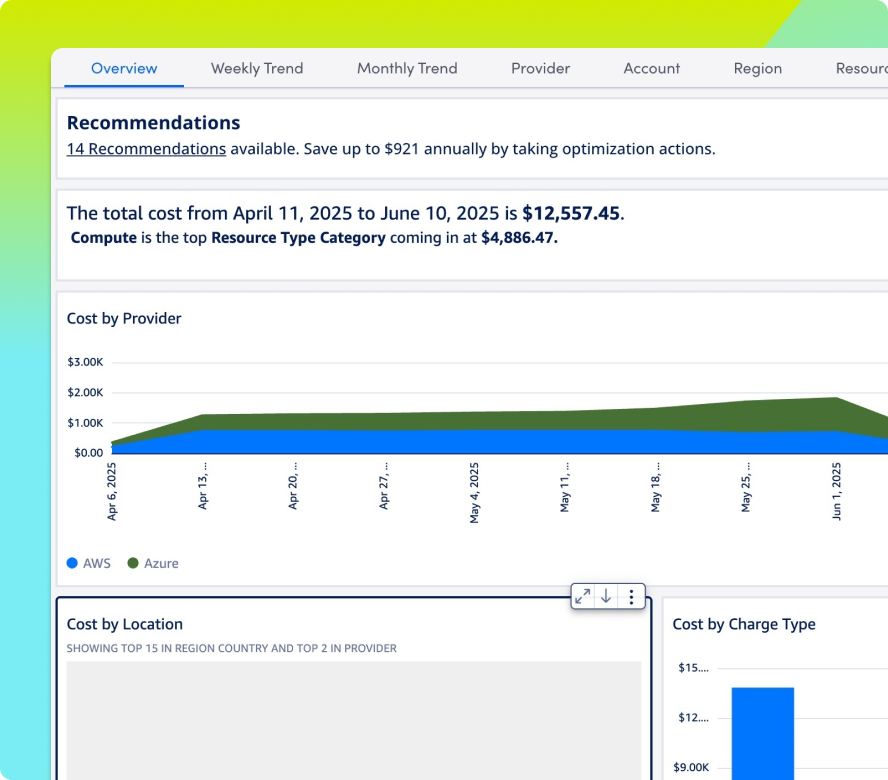

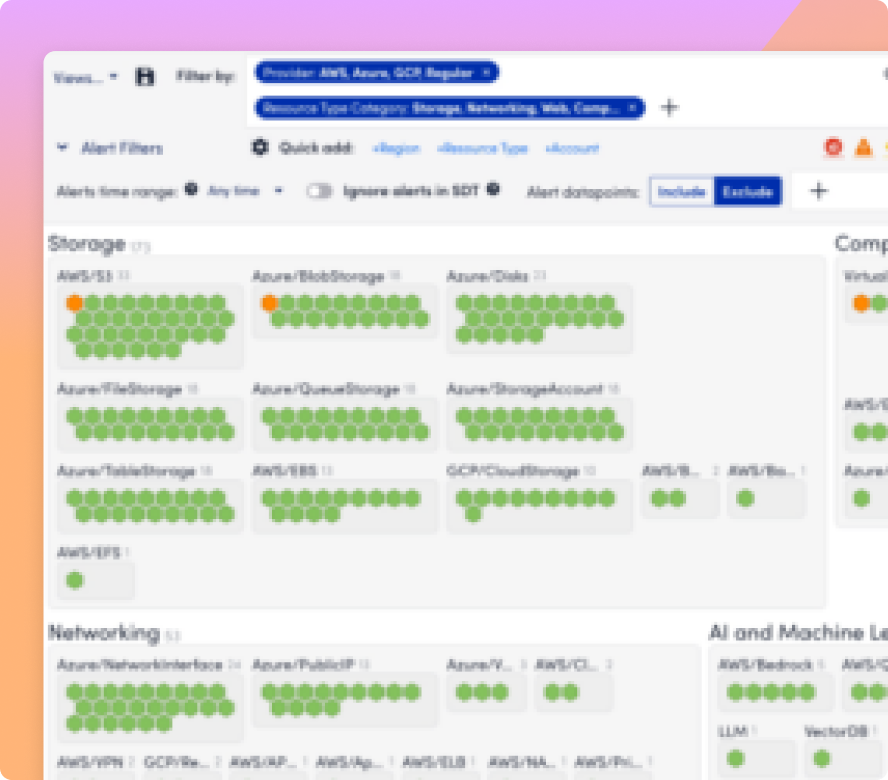

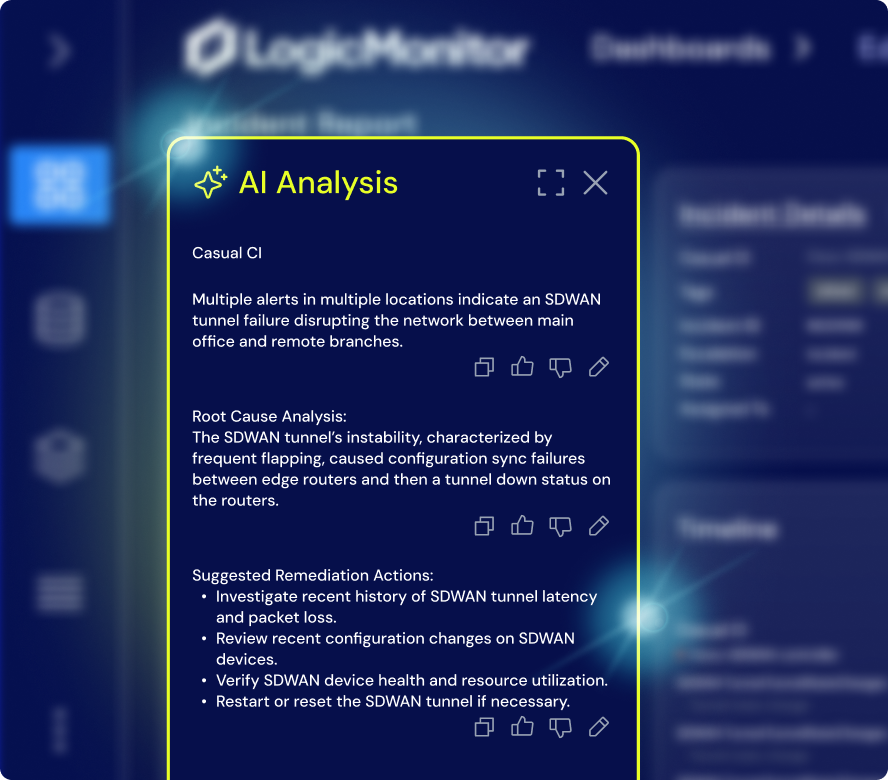

Observabilité de l'IA pour les l’infrastructure, les workloads et les pipelines dans une plateforme unique

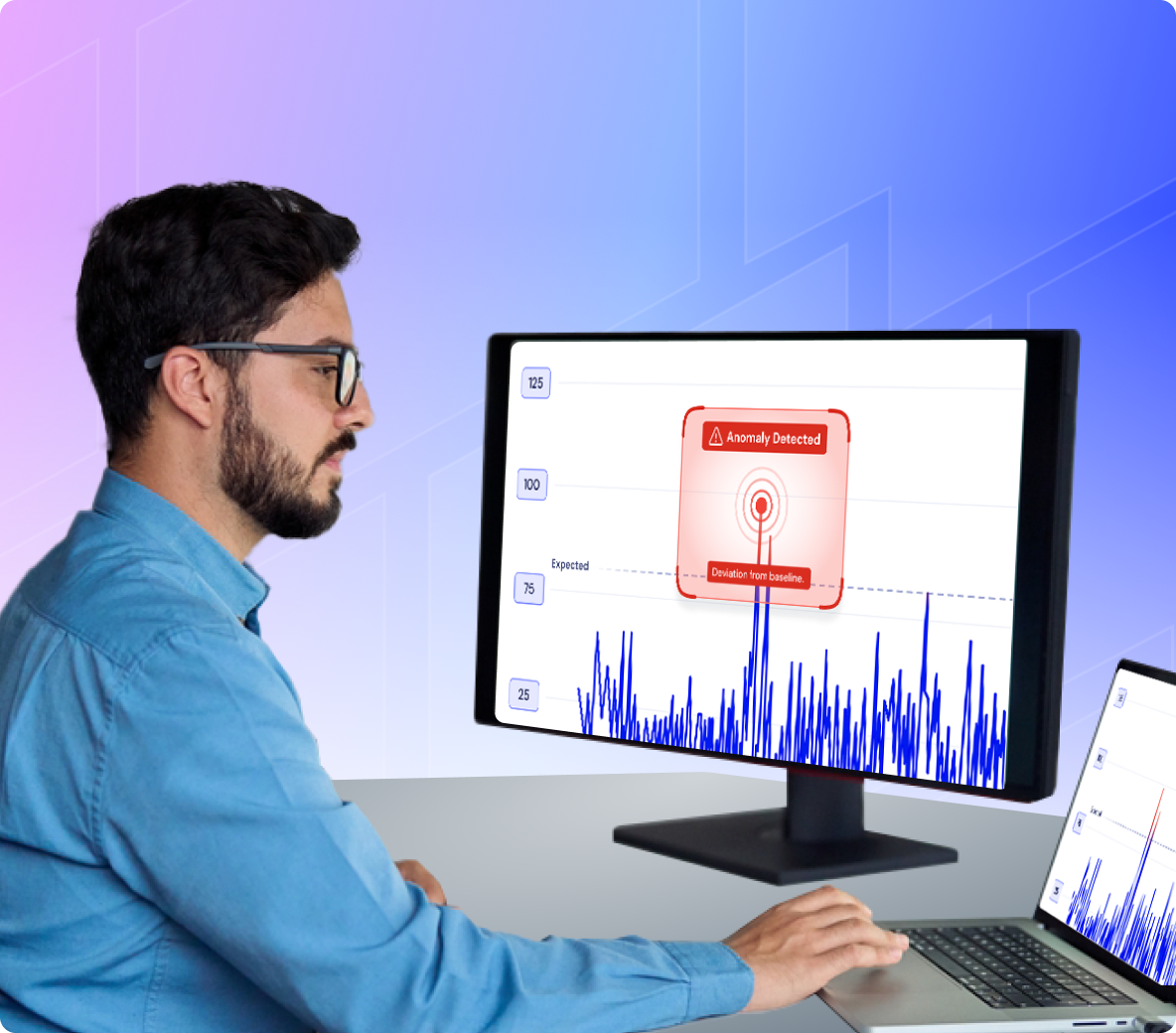

Unifiez chaque signal de votre environnement IA pour passer d’une gestion réactive des incidents à des décisions stratégiques, pilotées par la donnée.